一份由世界頂級(jí)會(huì)計(jì)師事務(wù)所發(fā)布的評(píng)估報(bào)告引發(fā)廣泛關(guān)注。報(bào)告顯示,上海市閔行區(qū)在政府服務(wù)與人力資源兩大關(guān)鍵領(lǐng)域的綜合評(píng)分均獲評(píng)最高的“五顆星”等級(jí),標(biāo)志著該區(qū)域在優(yōu)化營(yíng)商環(huán)境、提升公共服務(wù)效能方面取得了國(guó)際權(quán)威認(rèn)可的重大突破。

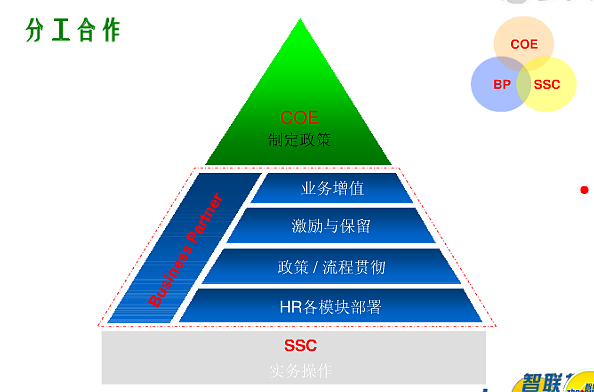

報(bào)告中特別指出,閔行區(qū)的人力資源服務(wù)體系展現(xiàn)出令人矚目的“世界級(jí)”水準(zhǔn)。這并非偶然,而是閔行近年來持續(xù)深化“放管服”改革、精準(zhǔn)施策培育人才生態(tài)的必然成果。區(qū)政府通過整合線上線下資源,打造了高效、便捷、透明的一站式人力資源服務(wù)平臺(tái)。無論是企業(yè)招聘、人才引進(jìn)落戶、職業(yè)技能培訓(xùn),還是勞動(dòng)保障咨詢與糾紛調(diào)解,企業(yè)和個(gè)人都能體驗(yàn)到標(biāo)準(zhǔn)化、專業(yè)化且充滿溫度的服務(wù)流程。平臺(tái)借助大數(shù)據(jù)與人工智能技術(shù),實(shí)現(xiàn)了政策精準(zhǔn)推送、需求智能匹配,顯著降低了企業(yè)與人才的制度性交易成本。

在政府服務(wù)層面,閔行區(qū)同樣贏得了“五顆星”的高度評(píng)價(jià)。評(píng)估方高度認(rèn)可其“一網(wǎng)通辦”的深度應(yīng)用、行政審批流程的極致簡(jiǎn)化以及與企業(yè)常態(tài)化、制度化溝通機(jī)制的建立。政府部門主動(dòng)跨前服務(wù),通過“企業(yè)服務(wù)專員”等制度,將扶持政策送上門,將難點(diǎn)問題解決在一線,形成了“親清”政商關(guān)系的良好范本。這種以市場(chǎng)主體需求為導(dǎo)向的服務(wù)理念,與高效的人力資源服務(wù)相輔相成,共同構(gòu)成了吸引和留住高端人才、助推產(chǎn)業(yè)升級(jí)的核心競(jìng)爭(zhēng)優(yōu)勢(shì)。

這份頂尖的評(píng)估報(bào)告,如同一面鏡子,映照出閔行區(qū)致力于打造國(guó)際化、法治化、便利化一流營(yíng)商環(huán)境的堅(jiān)實(shí)步伐。“政府服務(wù)”與“人力資源”雙五星的佳績(jī),不僅是一份榮譽(yù),更是一份責(zé)任與鞭策。它向全球投資者和優(yōu)秀人才發(fā)出了清晰而有力的信號(hào):閔行,正以其卓越的公共服務(wù)體系和充滿活力的人才發(fā)展環(huán)境,成為海內(nèi)外才智匯聚的高地、企業(yè)蓬勃發(fā)展的沃土。閔行區(qū)將持續(xù)對(duì)標(biāo)國(guó)際最高標(biāo)準(zhǔn),進(jìn)一步做優(yōu)服務(wù)品牌,激發(fā)人才創(chuàng)新活力,為區(qū)域經(jīng)濟(jì)高質(zhì)量發(fā)展注入更強(qiáng)勁、更持久的動(dòng)能。